Surgiram óculos de inteligência artificial (IA) que ouvem conversas e dizem o que dizer, combinando o modelo de linguagem em grande escala “GPT-4” com tecnologia de reconhecimento de voz e realidade aumentada (AR).

O Tom’s Hardware, um meio de comunicação de tecnologia, informou no dia 20 (horário local) que os alunos de Stanford desenvolveram óculos inteligentes de realidade aumentada “RizzGPT” usando o ChatGPT da Open AI.

Em outras palavras, o ChatGPT, que é usado para bate-papo, foi transformado em um ChatGPT portátil que pode interagir com outras pessoas no dia a dia.

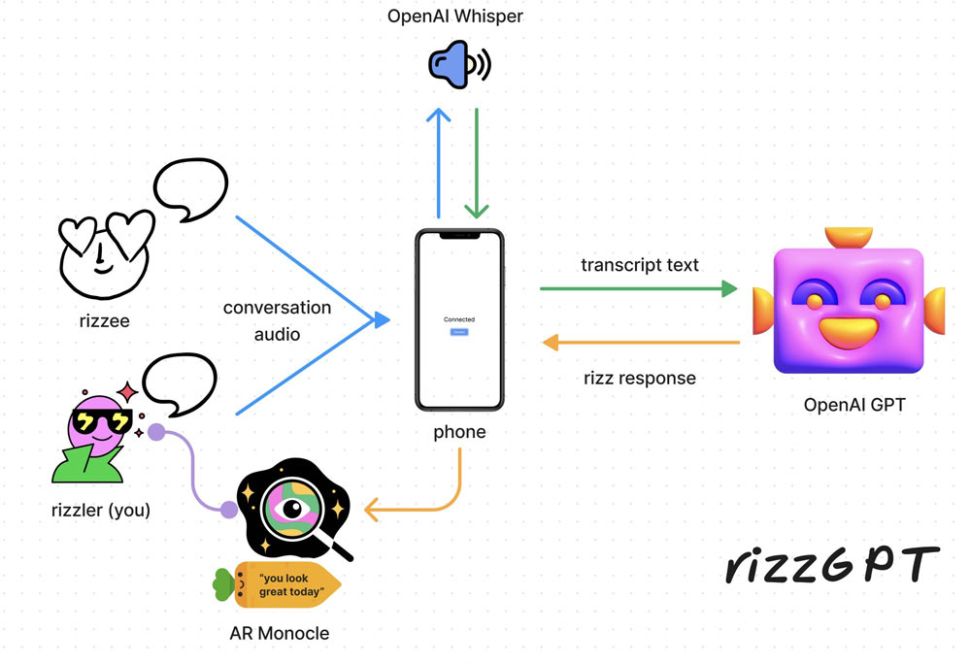

“LizGPT” é um produto que combina o modelo de linguagem em grande escala GPT-4 da Open AI e o modelo de reconhecimento automático de voz “Whisper” com óculos de realidade aumentada por meio de um smartphone.

O GPT-4 é usado para reconhecer perguntas, opiniões ou imagens durante conversas e gerar respostas em tempo real. Sussurro converte áudio em texto.

Usei os óculos AR do tipo clip-on ‘Monocle AR’ da Brilliant Lab, que consiste em uma câmera, microfone e tela de alta resolução. Como um prompt, ele exibe um texto que o usuário pode ler em tempo real.

O LizGPT entende a entrada da pergunta de áudio através do microfone conectado aos óculos AR ou a imagem detectada pela câmera AR e exibe a resposta derivada na tela dos óculos.

O LizGPT usa reconhecimento multimodal de texto, áudio e imagens para entender o que está acontecendo ao seu redor.

Vídeo de demonstração do Leeds GPT (Vídeo = Stanford University)

Os prompts diretos criados em movimento podem ajudar as pessoas em situações como se preparar para uma conversa pública, uma entrevista de emprego, encontrar um amigo ou pedir comida em um restaurante.

Por exemplo, ao encontrar um amigo, você pode usar a função de reconhecimento de imagem do GPT-4 para identificar o amigo e iniciar uma conversa com base nas mensagens do smartphone trocadas com o amigo.

Mesmo ao pedir comida em um restaurante, se você olhar ou ler o menu e pedir uma recomendação, o OCR ou o reconhecimento de voz será usado para recomendar alimentos com base em seus gostos e desgostos e no que você sabe sobre seu valor nutricional.

Chan Park, cpark@aitimes.com

“Leitor implacável. Especialista em mídia social. Amante de cerveja. Fanático por comida. Defensor de zumbis. Aficionado por bacon. Praticante da web.”