Os agentes de IA suportam ambientes industriais de grande escala, como o gerenciamento de vários robôs em uma fábrica ou a definição de configurações simplificadas para a colaboração humano-robô em centros de distribuição da cadeia de suprimentos. Para construir estes agentes complexos, os desenvolvedores precisam de um ambiente digital duplo, como um campo de treinamento de micro-IA, para avaliação, simulação e treinamento de IA.

Aqui, a NVIDIA anunciou que pode fazer progressos significativos na automação industrial, simulando inteligência artificial (IA) em tempo real com gêmeos digitais.

Se os desenvolvedores puderem usar gêmeos digitais para simular totalmente a IA em tempo real antes de aplicá-la à infraestrutura industrial, eles poderão desenvolvê-la, verificá-la e melhorá-la, disse Jensen Huang, fundador e CEO da NVIDIA, em sua palestra no GTC. Pode alcançar economias significativas em tempo e custo.

A IA em tempo real ajuda a resolver tarefas críticas na fabricação, logística de fábrica e robótica. A abordagem de simulação está levando a tecnologia de automação para o próximo nível em indústrias que lidam com produtos volumosos, equipamentos caros, ambientes robóticos colaborativos e instalações logísticas complexas.

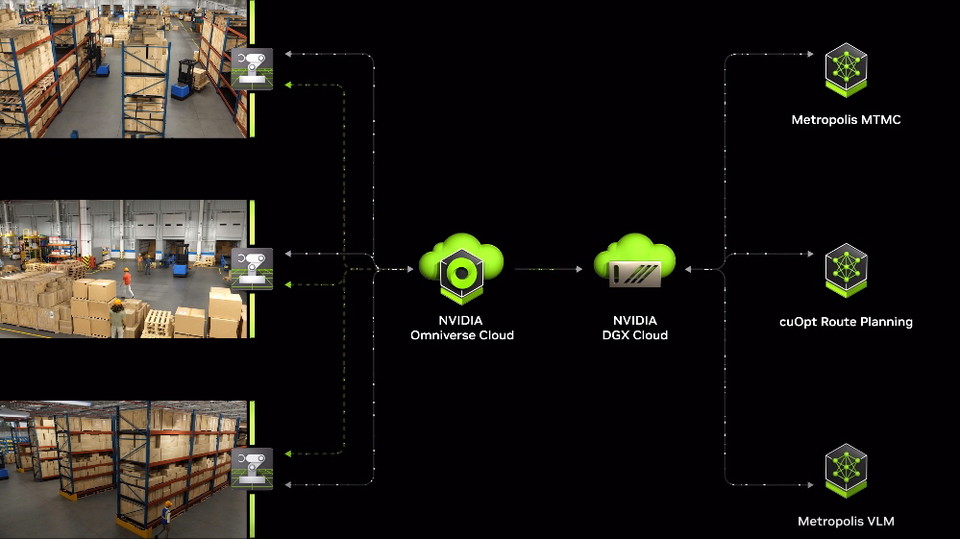

No ginásio de IA, onde as plataformas NVIDIA Omniverse, Metropolis, Isaac e cuOpt interagem entre si, os desenvolvedores criam agentes de IA para ajudar humanos e robôs a navegar em situações complexas e imprevisíveis, e podem ser treinados.

O vídeo de demonstração acima (Integrando Digital Twins e Real-Time AI) mostra um gêmeo digital de um armazém de 100.000 pés quadrados construído na plataforma NVIDIA Omnibus para desenvolvimento e comunicação de aplicativos OpenUSD. É usado como ambiente de simulação para dezenas de trabalhadores digitais, vários robôs móveis autônomos (AMR), agentes de visão de IA e sensores.

Cada robô autônomo que executa o conjunto multissensor NVIDIA Isaac Perceptor processa informações visuais usando seis sensores, todos simulados em um gêmeo digital.

Enquanto isso, a plataforma Metropolis da NVIDIA para Vision AI combina rastreamento multicâmera com fluxos de 100 câmeras montadas no teto para criar um mapa central da atividade dos trabalhadores em todo o armazém. Este mapa de ocupação central informa o caminho ideal do robô autônomo que é calculado pelo mecanismo NVIDIA cuOpt para resolver problemas complexos de roteamento.

cuOpt, o serviço líder de microotimização baseado em IA, usa algoritmos evolutivos acelerados por GPU para resolver problemas de roteamento complexos com múltiplas restrições. Todo esse processo ocorre em tempo real, e o Isaac Mission Control coordena todos os robôs autônomos com mapa cuOpt e dados gráficos de caminho para transmitir e executar comandos.

Agentes de IA e robôs autônomos podem se adaptar a ambientes imprevisíveis do mundo real por meio de testes de IA software-in-the-loop (SIL).

No vídeo de demonstração acima, ocorreu um acidente no meio do trajeto planejado do robô autônomo, obstruindo o trajeto e impedindo o robô de pegar o palete de carga. NVIDIA Metropolis então atualiza a grade de ocupação para mapear todas as pessoas, robôs e objetos de uma só vez. O robô autônomo então responde de acordo com o caminho ideal planejado pelo cuOpt para minimizar o tempo de inatividade.

O modelo Metropolis Vision Foundation executa a estrutura NVIDIA Visual Insight Agent (VIA), permitindo que os agentes de IA respondam às perguntas das equipes de operações, como “O que aconteceu na pista 3 da planta?” E respondendo a perguntas como “15h, você pode fornecer respostas imediatas, como “Uma caixa caiu da prateleira às 13h30 e bloqueou o corredor”.

Com o Vision Insight Agent Framework, os desenvolvedores podem criar agentes de IA capazes de processar grandes quantidades de vídeos e imagens arquivados em tempo real usando modelos de linguagem implantados no Edge e no Cloud Vision. Espera-se que esse agente de IA de visão de próxima geração seja capaz de beneficiar quase todos os setores, resumindo, pesquisando e extraindo insights acionáveis de vídeo usando linguagem natural.

Todos esses recursos de IA são aprimorados por meio de treinamento contínuo baseado em simulação e implantados como serviços de inferência de modelo NVIDIA NIM.

“Leitor implacável. Especialista em mídia social. Amante de cerveja. Fanático por comida. Defensor de zumbis. Aficionado por bacon. Praticante da web.”