A Upstage revelou seu Small Language Model (sLM) “Solar” desenvolvido por ele mesmo. Em particular, com base no desempenho recorde, expressaram a sua confiança em competir com grandes empresas globais de tecnologia.

Upstage (CEO Kim Seong-hoon), uma empresa de inteligência artificial (IA), anunciou no dia 14 que participará da competição global Large Language Model (LLM), revelando as especificações e resultados de benchmark da Solar.

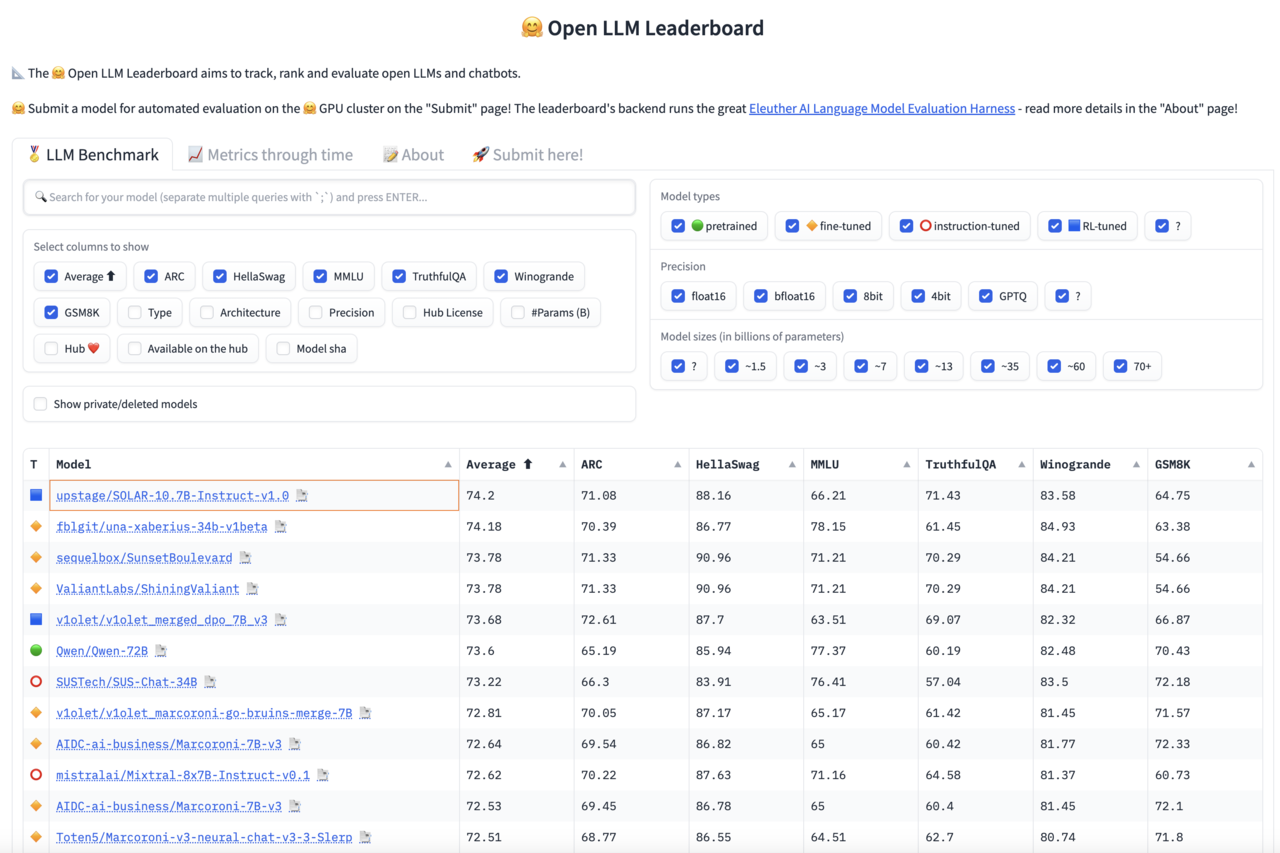

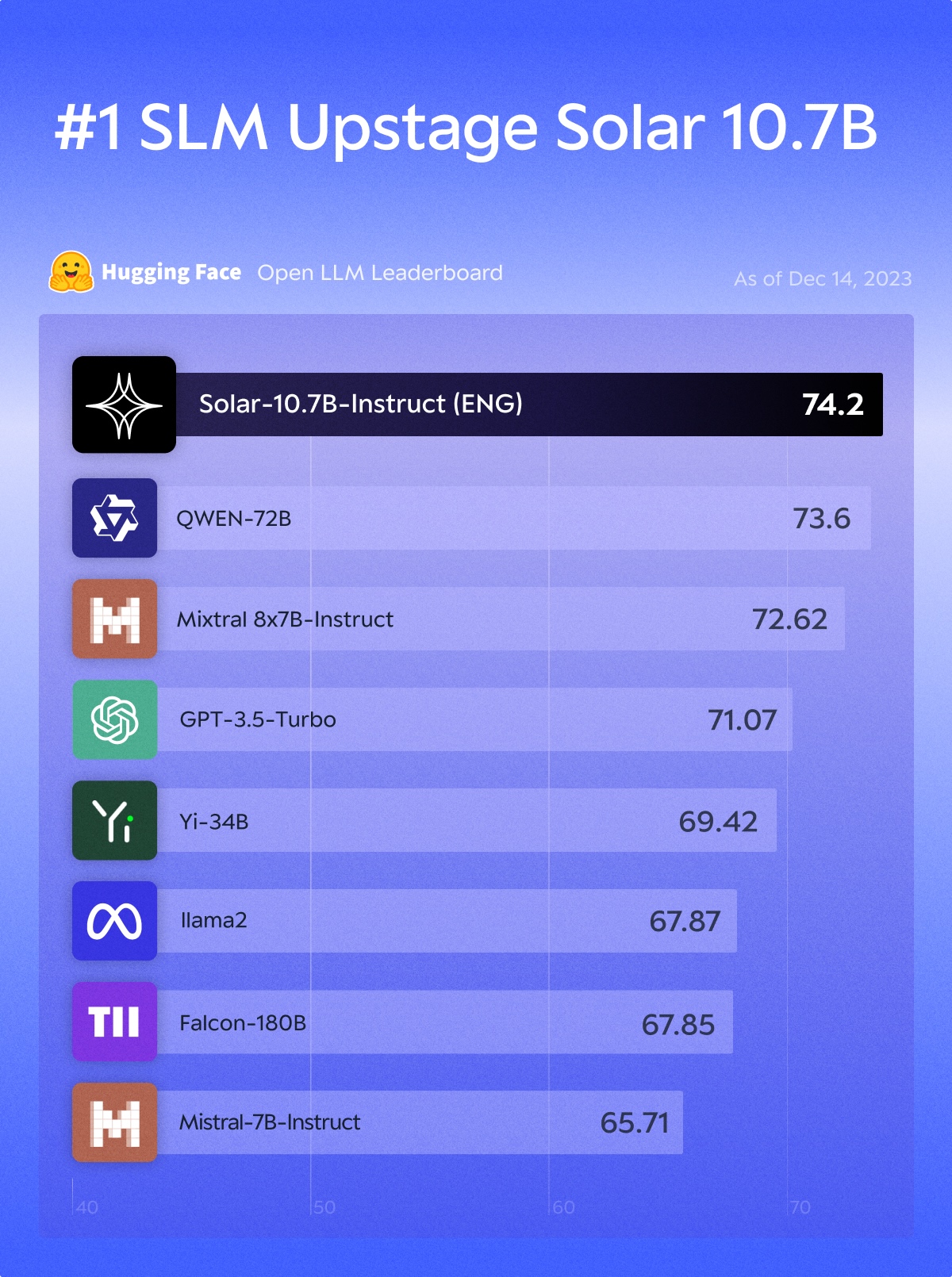

Foi baseado em um modelo que ficou em primeiro lugar no “Open LLM Leaderboard” da Hugging Face em agosto passado, superando as pontuações “Rama 2” e “GPT-3.5”. 30 bilhões de parâmetros (30B), que podem ser considerados o padrão sLM ou menor, superam modelos maiores.

Solar é um modelo de pré-aprendizagem configurado em um tamanho menor de “LLM privado” que é mais fácil de usar pelas empresas. Pela primeira vez como modelo com 10,7 bilhões de parâmetros, obteve 74,2 pontos na avaliação da tabela de classificação e ficou em primeiro lugar geral. Em particular, é um sexto menor que o modelo mais recente do Alibaba, o Coin, que foi recentemente destacado.

“Para obter todos os benefícios entre os modelos 7B e 13B, usamos o modelo 7B de código aberto e adicionamos camadas para aumentar a profundidade. No final, acabamos com o 10,7B, equilibrando o tamanho”, explicou. e desempenho.”

Além disso, em vez de usar conjuntos de dados de referência nas fases de pré-aprendizagem e ajuste fino, eles disseram que melhoraram o desempenho aplicando dados autogerados. Como resultado, foi confirmado que superou o mais recente modelo Mistral AI, o “Mixtral 8x7B”.

A Upstage até lançou modelos de pré-aprendizagem e os disponibilizou para uso comercial. O modelo de pré-aprendizagem também ficou em primeiro lugar com pontuação de 66,04 pontos na tabela de classificação Hugging Face, superando os modelos Q1, Rama 2 e Mistral.

Kim Seung-hoon, CEO da Upstage, disse: “Esperamos que a Solar possa se tornar um modelo para todos. O apoio da KT, incluindo o investimento estratégico, tem sido uma grande ajuda, e continuaremos a buscar a cooperação no mercado B2B, aproveitando a energia solar modelo.”

Como tal, tornou-se recentemente uma tendência na indústria global de LLM revelar resultados de benchmark juntamente com o lançamento de novos modelos.

A Upstage também pretende explorar seriamente o mercado global, oferecendo sua tecnologia de ajuste fino com base em seu desempenho de referência.

Repórter Jang Si Min semim99@aitimes.com

“Leitor implacável. Especialista em mídia social. Amante de cerveja. Fanático por comida. Defensor de zumbis. Aficionado por bacon. Praticante da web.”